Google AI反擊戰︱Gemini 3碾壓GPT-5.1、TPU挑戰GPU!OpenAI、NVIDIA還能穩坐龍頭嗎?

在生成式AI賽道上,AI界老大哥Google一直落後於後起之秀OpenAI,但近期市場形勢卻開始出現鬆動:Google先憑藉新一代大型語言模型Gemini 3在基準測試碾壓GPT-5.1,接著傳出Meta正考慮採購其自研AI晶片TPU,作為輝達(NVIDIA)GPU的替代方案,似乎有反撲OpenAI與NVIDIA兩大AI巨頭,奪回AI霸主地位之勢。究竟Google施展了甚麼奇策來扭轉頹勢?OpenAI與NVIDIA又是否真的已被Google完全壓倒?

Read More

Google最強AI模型來襲!Gemini搶攻企業、消費者、手機3大領域,建立完整AI生態圈碾壓ChatGPT!

代理式AI崛起!Gemini 2.0變身智能助理,無需人類介入,完全自主決策和行動,我們準備好了嗎?

NVIDIA霸權終結?4大雲端巨頭發動「去GPU化」革命!黃仁勳如何守住AI龍頭寶座?

Gemini 3突破模型訓練天花板

2025年11月18日,Google正式推出Gemini 3,表現令人驚艷。在20項AI基準測試中,Gemini 3在專家級知識、數學問題、邏輯謎題、以至圖像辨識等項目,全面拋離OpenAI GPT-5.1與Anthropic Claude 4.5。

投資銀行D.A. Davidson表示,對Gemini 3初步測試印象深刻,稱讚它是「真正強大的模型」與「當前最先進的技術」。另一投行Robert W. Baird & Co.分析師Colin Sebastian直言:「Gemini 3是否呈現了GPT-5應有的水準?」他指出,Google透過即時網上索引與先進模型訓練方法,提升其搜尋互動與商業化能力,足以形成關鍵競爭優勢。

Gemini 3之所以有如此飛躍進步,主因是Google在模型訓練方法上取得重大突破。一直以來,每當要訓練新模型,研發人員會匯入大量文字資料,以供模型學習各方面的知識;模型若要擁有圖像辨識能力,則會替其加裝視覺模組,然後透過這個「外掛」來理解圖像內容。正如一個香港人要處理韓文資料,需有Google Translate這個「外掛」幫忙翻譯。

相較於傳統的「外掛式」多模態模型,Gemini 3則是「原生」多模態模型。Google從訓練模型之初,便同時輸入文字、圖像、音訊、影片、程式碼等不同模態的數據,讓它能在單一模型架構內理解不同媒體類型資訊。

Google執行長桑達爾·皮查伊(Sundar Pichai)表示,Gemini 3的誕生象徵著Google已「走到了另一邊」,準備重新站上生成式AI賽道的領跑位置。(圖片來源:翻攝Google官方YouTube影片)

Google TPU成本效益優於GPU

假設有用戶輸入圖片、PDF,再加上文字提示,要求Gemini 3分析圖片和文件中的資訊,然後撰寫摘要。Gemini 3會針對不同類型的輸入資料進行編碼,並映射到同一語意空間內解讀,讓模型能以更接近人類直覺的方式來理解這些複合內容。這就好比一名畢業於首爾大學韓語教育院的香港人,在處理韓文資料時,能夠直接讀懂內容,並明白箇中的文化含意和歷史典故,於是可以產製更符合用戶要求的內容。

就算Gemini 3性能多麼強大,如沒有足夠的運算力支撐,也難以回應全球用戶的提問。早於2015年,Google已開始研發自家AI晶片「TPU」(Tensor Processing Unit),發展至今已來到第七代「Ironwood」。因此,相較於微軟、亞馬遜(Amazon)、Meta等雲端巨頭,Google對NVIDIA GPU的依賴性較低。

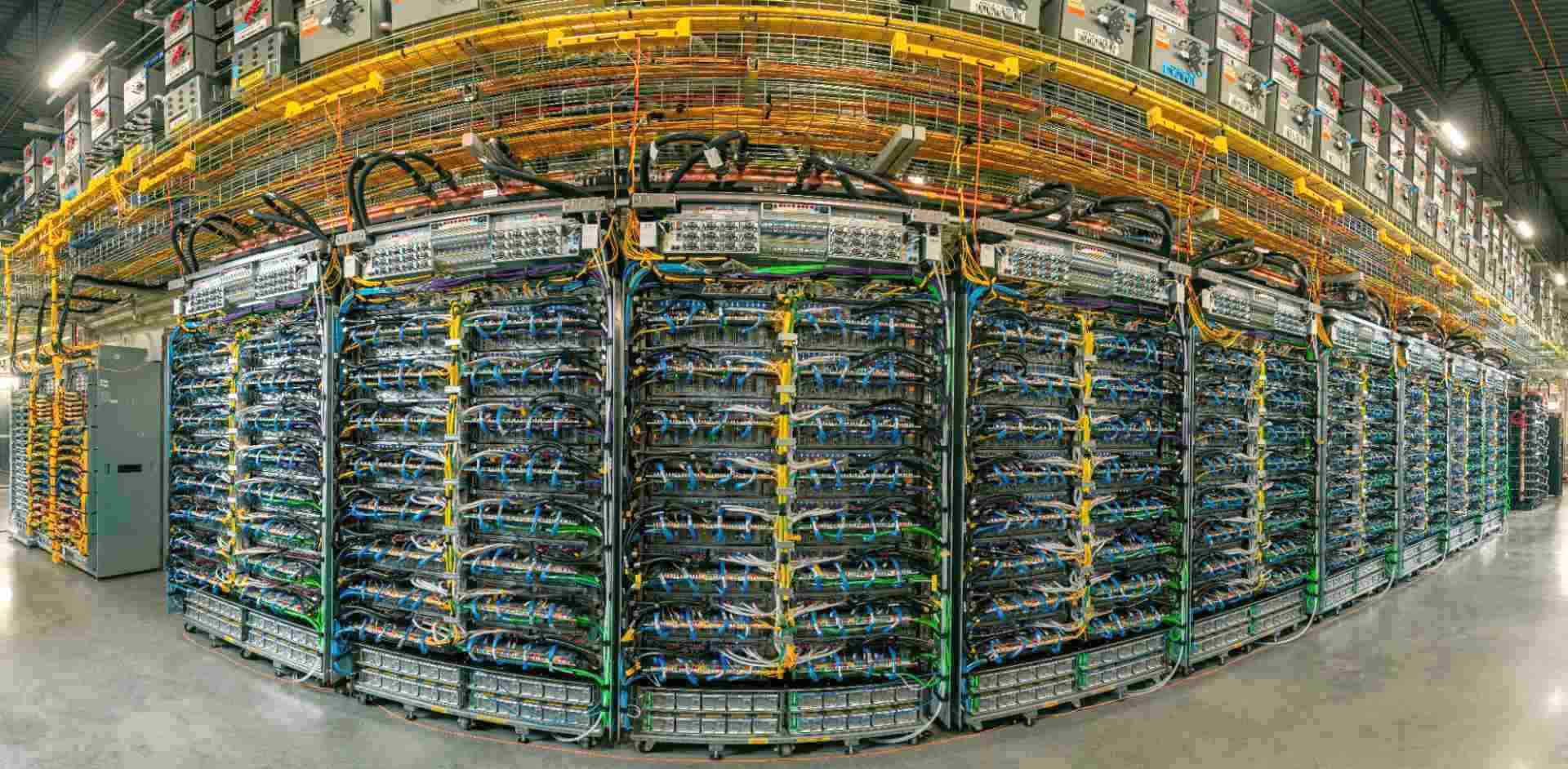

Ironwood晶片的浮點運算能力高達4.6 PetaFLOPS,跟NVIDIA Blackwell B200同級。其更強之處是,能將9,216顆晶片連結在一起,組成總運算力達到42.5 ExaFLOPS 的超級運算集群,為Gemini推論(Inference)運算帶來更具成本效益的解決方案。有前Google部門主管指出,TPU運作效率比GPU高出60 %至65 %。

Google能夠在單一網域中連接9,216顆Ironwood TPU,串連成超級運算集群。(圖片來源:Google官網)

掌握模型、硬件、分發三大支柱

除Google自家使用外,TPU亦開始提供給外部客戶使用。2025年10月,AI初創Anthropic宣布跟Google簽訂價值數百億美元的合作協議,當中包括使用100萬顆TPU,以支援其Claude模型的訓練與推論運作。

更震撼的是,有消息指Meta正考慮購入TPU,用作興建新數據中心,採購規模可能高達數十億美元。假如消息屬實,Meta可望成為Google自研晶片的最大外部客戶,代表著TPU有能力挑戰NVIDIA GPU在數據中心市場的領導地位。結果,此消息讓輝達股價一度下挫3%。

投資分析機構Rebound Capital認為,在AI生態圈中,Google是唯一一家同時握有模型研發、硬件基建、以及分發渠道的企業。這三項能力構成一條由底層到前端的完整生態鏈,讓 Google 能自行設計晶片、訓練和部署AI模型,並透過自家入口平台(如Google Search、Gmail、Android等)把AI技術推向全球用戶。對手即使在某一環節具備優勢,也較難在短期內複製這種縱向整合能力。

OpenAI承認面臨短暫經濟逆風

正因如此,Google現在終於可以享受AI紅利,其母公司Alphabet近期股價大漲,市值逼近4兆美元(約31.2兆港元)大關,現已超越微軟(Microsoft),躍居為全球市值第三大企業,市場更開始視之為「AI新王」。

面對來勢洶洶的Google,AI軟件龍頭OpenAI已感受到一定壓力。其執行長山姆·奧特曼(Sam Altman)在一份內部備忘錄向員工表示,Google最近在AI領域取得重大進展,可能會為OpenAI帶來「暫時性經濟逆風」。

奧特曼在公司內部坦言,不介意讓OpenAI在短期內看似落後,只要能換來具有突破性的長期技術成果,當中包括自動化AI研發流程。(圖片來源:翻攝OpenAI官方YouTube影片)

奧特曼坦承,OpenAI在模型訓練階段遇到不少技術障礙亟待克服。研發團隊發現,隨著模型規模擴大,部分既有技術方案會變得不可靠,導致整體性能難以穩定地提升。有鑑於此,該公司正研發代號為「Shallotpeat」的新模型,以解決訓練環節的技術問題;又打算透過自動化AI研發流程,以加速新模型的迭代和開發。這代表OpenAI不僅要修正底層訓練機制,還在嘗試改變整個模型研發流程。

NVIDIA豪言領先業界一個世代

另一邊廂,AI晶片霸主NVIDIA近日在社交媒體X上霸氣地表示:「輝達領先整個產業一個世代」,自認是「唯一可以在任何運算環境下,運行所有AI模型的平台」,又強調相比起專為特定用途而設計的ASIC晶片(意指TPU),NVIDIA GPU提供更強效能、更高通用性與可替換性,似乎是回應Meta可能採購Google TPU的傳聞。

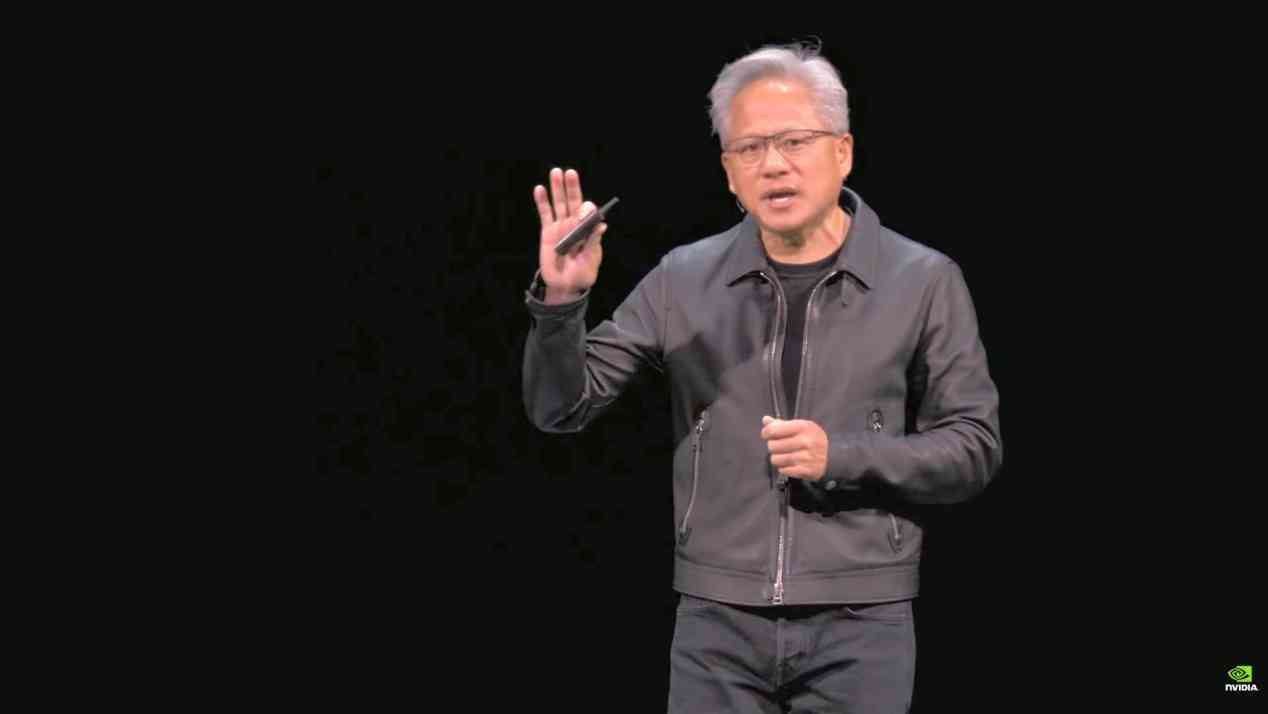

NVIDIA執行長黃仁勳表示,Google依然是其重要客戶,Gemini系列模型也能在輝達運算平台上順利運行。(圖片來源:翻攝NVIDIA官方YouTube影片)

事實上,無論是Google或Meta,均難以完全捨棄NVIDIA GPU。現時NVIDIA GPU仍是主流AI運算平台,Google還需持續購入,以應付雲端客戶需求。Meta既有的AI系統架構跟TPU並不兼容,如要切換為可支援TPU運作,將面臨極大的軟硬件整合難題,故此Meta難以全盤轉用TPU,只能在建造新數據中心時嘗試部署。

由是觀之,日後AI市場形勢可能會出現微妙變化:Google在技術上反超前OpenAI,加上分發渠道的優勢,似乎有望壓倒OpenAI,勝負關鍵在於OpenAI能否在短時間內推出性能更強的新模型。至於在AI晶片領域,主要玩家均積極尋求合作夥伴,以分散單一供應商的風險,這或許會稍微分薄NVIDIA的市場份額,但始終無法動搖其霸主地位。

Add a comment ...

Add a comment ...

Comment

暫無回應